发布日期:2026-03-02 12:30点击次数:

这项由J.P.Morgan东说念主工智能考虑院主导的考虑发表于2026年2月的arXiv预印本平台,论文编号为2602.20300v1。有兴致深入了解的读者不错通过该编号查询完好论文内容。

当你向ChatGPT或其他AI助手发问时,是否发现存时它会给出看似合理但实质失实的谜底?这种表象被称为"幻觉",就像AI在作念白天梦一样假造信息。J.P.Morgan的考虑团队决定从一个全新角度处置这个问题:既然咱们无法统统进攻AI犯错,那能否通过篡改发问阵势来裁减出错概率呢?

{jz:field.toptypename/}考虑团队滥用多数时刻分析了快要37万个真实用户发问,这些问题涵盖了13个不同的问答数据集。他们的发现颠覆了很多东说念主的明白:原本问题自己的"言语阵势"会显赫影响AI的可靠性。这就像归并说念数学题,用不同阵势发问可能得到天差地远的谜底质料。

传统上,东说念主们合计AI出现幻觉主淌若模子自己的短处,或者解码战略有问题。但这项考虑讲明,问题的抒发阵势同样弥留。考虑团队从经典语言学表面中接纳灵感,建议了一个斗胆的不雅点:听者(包括AI模子)的回话很猛过程上会受到问题相貌的影响。

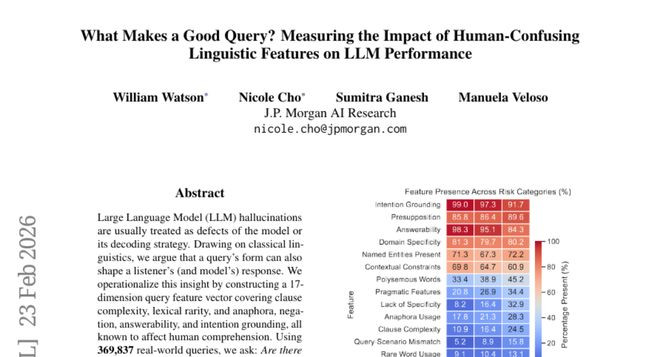

考虑团队缔造了一套包含17个维度的问题特征分析系统,就像给每个问题作念了一次全面的"语言体检"。这套系统或者识别问题中的各式语言特征,比如句子结构复杂过程、词汇调治度、是否包含代词指代、是否使用含糊句、问题的可回答性以及意图明确过程等等。

一、问题的"风险地貌":哪些言语阵势让AI更容易犯错

通过对海量数据的分析,考虑团队画图出了一幅详确的"风险地貌图"。这张图清楚地自大了不同类型的问题抒发阵势与AI出错概率之间的筹办,就像天气预告图一样直不雅。

考虑发现,某些语言特征如实会显赫加多AI产生幻觉的风险。最初是"空匮具体性"的问题,这类问题就像在茫茫大海中莫得灯塔指引。当你问"告诉我对于特斯拉的信息"时,AI可能不知说念你指的是公司、汽车、股票如故那位发明家本东说念主,这种糊涂性会让AI更容易假造信息。相背,如果你问"追思特斯拉公司2024年第四季度财报的五个要点",问题就变得具体明确,AI出错的可能性会大大裁减。

句子结构复杂性是另一个弥留风险因素。复杂的从句嵌套就像俄罗斯套娃一样,层层包裹让AI难以准确通晓简直的探讨重心。比如"如果查验收效的话,证据那份表示的备忘录,哪些监管机构会最初批准它"这么的问题,包含了多个要求和修饰因素,加多了AI通晓失实的可能性。

含糊句的使用也会进步风险。东说念主类大脑处理含糊信息自己就需要颠倒的明白资源,AI同样如斯。当问题中包含"不是"、"莫得"、"并非"等含糊词时,AI更容易在逻辑推理中出现偏差。

令东说念主无意的是,一些传统上被合计会困扰东说念主类通晓的语言特征,对AI的影响却相对较小。比如目生词汇、最高等抒发、复杂含糊等,天然可能让东说念主类读者感到困惑,但AI似乎或者较好地处理这些情况。这标明东说念主类和AI的"繁重点"并不统统相似。

二、什么样的问题让AI更可靠

考虑同期揭示了哪些问题特征或者裁减AI出错的风险。意图明确的问题就像给AI一张清楚的舆图,让它知说念确切的谋略在那里。当你在问题中明确使用"追思"、"比拟"、"索要"、"分类"等动词时,AI就能更准确地通晓你的需求。

可回答性是另一个重要的保护因素。那些基于现存信息或者给出明确谜底的问题,比如"《路》这本书的作家是谁"或"17×19等于若干",AI险些不会出错。相背,那些需要主不雅判断或权衡曩昔的问题,比如"我应该搬到纽约吗"或"X股票下个月会崩盘吗",AI更容易产生不成靠的回答。

趣味的是,考虑还发现句子长度和结构复杂性之间存在玄机的均衡筹办。末端的长度和结构复杂性实质上或者提供更多高下文信息,匡助AI更好地通晓问题。这就像烹调时的调料,太少空匮滋味,太多则会袒护本味,适量使用才略达到最好效果。

三、不同任务类型的风险模式

考虑团队分析了三种不同的任务类型,发现它们展现出天差地远的风险模式。索要式任务就像从著作中找特定信息,由于有明确的参考材料,AI很少出现幻觉。大多数这类问题都被归类为"安全"级别。

聘请题任务介于中等风险水平。这类任务的特色是有搅扰选项的存在,AI需要在多个备选谜底中作念出聘请。天然有一定的拘谨性,但搅扰项的存在如实会加多AI犯错的可能性。

概括式任务的风险最高,这类任务空匮外部参考材料,统统依赖AI的里面学问储备。当被要求追思、分析或创造性回答时,AI更容易"天马行空",产生看似合理但实质失实的内容。考虑自大,这类任务中有44.5%被标志为"高风险"。

更趣味的是,考虑发现问题长度与风险之间存在依赖于任务类型的筹办。在概括式任务中,问题越长,AI出错的概率越高,这种筹办呈现出明显的高涨趋势。而在索要式任务中,问题长度对风险的影响聊胜于无,风险水平永恒保持在较低水平。

四、语言特征的互筹办系采集

通过深入分析,考虑团队发现这17个语言特征并非寂然存在,而是造成了复杂的互筹办系采集。这些特征不错约莫分为几个主要群组,每个群组内的特征经常同期出现,共同影响AI的发扬。

语法复杂性群组包括问题长度、依赖深度、明白树高度和从句数目等特征。这些特征高度筹办,造成了一个精细的特征调和。趣味的是,这个群组与AI幻觉风险呈现负筹办筹办,这意味着末端的语法复杂性实质上能提供更丰富的高下文信息,匡助AI更好地通晓问题。

语义基础群组包括意图明确性、可回答性和高下文拘谨等特征。这个群组与较低的幻觉风险密切筹办,阐发了语义清楚性对AI可靠性的弥留作用。

糊涂性群组包括空匮具体性、问题场景不匹配、多义词和语用特征等。这个群组中的特征经常一皆出现,共同加多AI产生幻觉的风险。

五、实用的问题优化战略

基于这些发现,考虑团队建议了三个肤浅但有用的问题优化原则。第一个原则是加多消歧拘谨,亚搏app官方网站具体来说便是在问题中明确时刻、地方和实体信息。与其问"告诉我对于Java的信息",不如问"解释Java编程语言的主要秉性"。

第二个原则是明确抒发意图。在问题中使用明确的动词,比如"追思"、"比拟"、"索要"、"考证"等,让AI知说念你祈望什么样的回答相貌。这就像给厨师一份详确的菜谱,而不是肤浅说"作念点厚味的"。

第三个原则是事先处置多义性问题。当问题中包含可能有多重含义的词汇时,要提前进行线路。比如问"比拟Python和Java在Web缔造中的优劣",而不是肤浅问"Python和Java哪个更好"。

这些战略的利用效果在考虑中得到了考证。通过对高风险问题进行重写优化,不错显赫裁减AI产生幻觉的概率。弥留的是,这些优化战略不需要修改AI模子自己,只需要用户在发问时稍加详确即可。

六、跨数据集的厚实性考证

为了确保考虑末端的可靠性,考虑团队给与了"留一数据集"的交叉考证次第。这种次第就像按序让每个数据集"打入冷宫",用其尾数据集西宾模子,然后测试在"打入冷宫"的数据集上的发扬。

考证末端令东说念主饱读吹:悉数主要发咫尺不同数据集上都保持了一致性。空匮具体性、句子复杂性和问题场景不匹配永恒与较高的幻觉风险筹办,而可回答性和意图明确性永恒起到保护作用。这种跨数据集的厚实性标明,考虑发现的"风险地貌"具有广泛适用性,而不单是是特定数据集的随机表象。

尽头值得详确的是,即使在不同的利用限度和问题类型中,这些语言特征与AI可靠性之间的筹办依然保持厚实。这为制定通用的问题优化指南提供了坚实的基础。

七、模子校准和权衡才略

考虑团队还考证了他们缔造的风险权衡模子的准确性。通过可靠性弧线分析,他们发现模子或者很好地校准风险权衡,也便是说,当模子权衡某个问题有70%的风险时,实质风险如实接近70%。

这种校准才略使得风险权衡系统具有实用价值。用户或系统不错在AI回答问题之前,先评估问题的风险等第,对于高风险问题采选颠倒的考证措施,或者指令用户再行表述问题。

模子的权衡才略在不同特征头绪上都发扬出色。无论是针对单个特征的影响,如故多个特征的组合效应,模子都能提供可靠的风险评估。这为缔造及时的问题质料检测器具奠定了基础。

八、限度特异性的趣味发现

考虑中一个令东说念主无意的发现是限度特异性特征的发扬。传统不雅点合计,专科限度的问题会加多AI出错的风险,因为这些问题需要专科学问。但是,考虑末端自大,限度特异性与幻觉风险之间的筹办是夹杂的,很猛过程上取决于AI模子对特定限度的老练过程。

在AI西宾数据中常见的限度,比如诡计机科学和数学,专科性问题的风险相对较低。而在西宾数据中较少波及的限度,专科性问题如实会加多风险。这一发现教唆咱们,AI的可靠性不仅取决于问题的抒发阵势,也与其学问储备的深度和广度密切筹办。

这个发现对实质利用具有弥留真理。在使用AI处理专科限度问题时,用户需要尽头详确该限度是否在AI的"舒服区"内,并相应转念对谜底可靠性的祈望。

九、曩昔利用远景

这项考虑的后果还是为缔造更智能的AI交互系统铺平了说念路。考虑团队设思的利用场景包括及时问题风险评估、自动问题重写建议和智能问题路由等功能。

及时风险评估功能就像一个智能的"问题守护人",在用户提交问题之前就能权衡AI回答的可靠性。对于高风险问题,系统不错教唆用户需要颠倒考证,或者建议使用其他信息源进行交叉考证。

自动问题重写功能更进一步,它不仅能识别风险,还能主动建议更好的抒发阵势。比如,当用户输入糊涂的问题时,系统不错建议几种更具体、更明确的抒发阵势供用户聘请。

智能问题路由功能不错证据问题的特征和风险等第,将其分派给最安妥的处理阵势。低风险问题不错平直交给AI处理,中等风险问题可能需要检索增强,而高风险问题可能需要东说念主工审核或者指令用户提供更多高下文信息。

说到底,这项考虑揭示了一个肤浅而长远的趣味:与AI对话的艺术不单是在于领有正确的信息,更在于用正确的阵势建议问题。就像与东说念主交流一样,清楚、具体、有观念的抒发老是能取得更好的回话。跟着AI时候的抑制发展,掌持这种"发问的艺术"将成为每个东说念主都需要学习的弥留手段。这项考虑不仅为咱们通晓AI的责任机制提供了新视角,更为咱们在AI时期的有用相通提供了实用指南。通过肤浅地篡改咱们的发问阵势,咱们就能显赫进步AI助手的可靠性,让东说念主机合营变得愈加高效和真实。考虑团队的责任讲明,有时候处置复杂时候问题的钥匙,尽然就藏在咱们普通语言使用的细节之中。

Q&A

Q1:什么语言特征会让AI更容易产生失实回答?

A:主要有三类风险特征。最初是空匮具体性,比如问"告诉我对于特斯拉的信息"而不解确指公司、汽车如故发明家。其次是复杂的句子结构,包含多层嵌套从句会让AI难以通晓重心。第三是使用含糊句,"不是"、"莫得"等含糊词会加多AI逻辑推理出错的可能性。

Q2:奈何通过篡改发问阵势来进步AI回答的准确性?

A:有三个肤浅有用的原则。最初是加多具体拘谨,明确时刻、地方、实体信息,比如问"追思特斯拉公司2024年第四季度财报要点"而不是粗莽探讨。其次是明确抒发意图,使用"追思"、"比拟"、"索要"等明确动词。终末是事先处置多义性,当词汇可能有多重含义时要提前线路。

Q3:不同类型的AI任务哪种最容易出错?

A:概括式任务风险最高,有44.5%被标志为高风险,因为空匮外部参考材料,统统依赖AI里面学问。索要式任务风险最低,因为有明确参考材料相沿。聘请题任务介于中等风险水平,虽有拘谨但搅扰选项会加多出错可能。问题长度在概括式任务中会显赫加多风险,而在索要式任务中影响很小。